После нескольких месяцев слухов и спекуляций OpenAI анонсировала GPT-4 : последнюю в своей линейке языковых моделей ИИ, которые используются в таких приложениях, как ChatGPT и новый Bing.

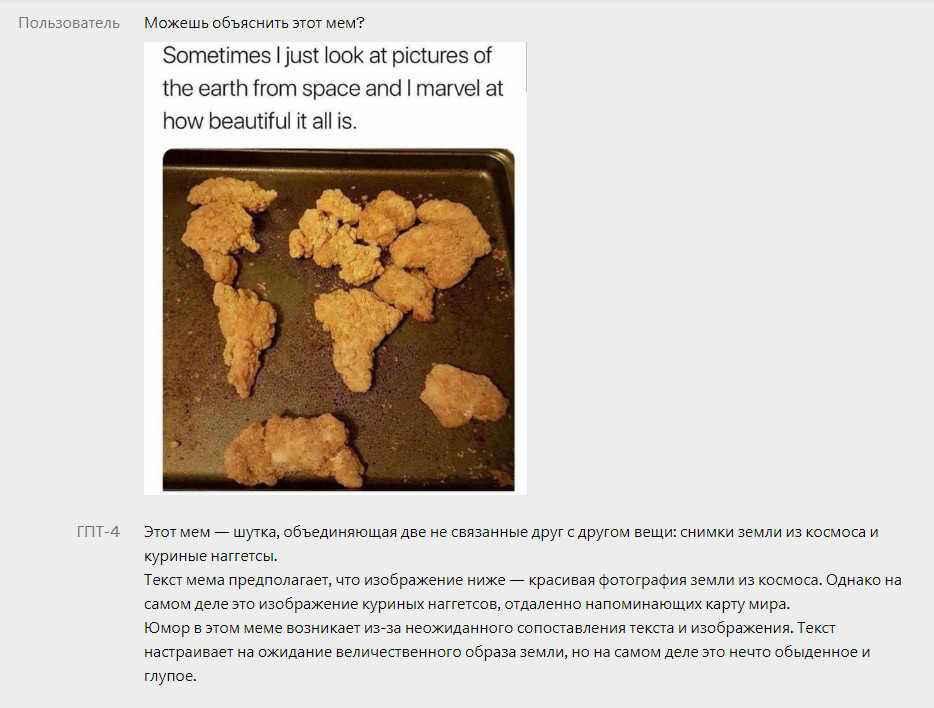

Компания утверждает, что модель более творческая и может решать сложные проблемы с большей точностью. Модель может анализировать как текст, так и ввод изображения, хотя может отвечать только текстом. OpenAI также предупреждает, что системы сохраняют многие из тех же проблем, что и более ранние языковые модели, в том числе тенденцию выдумывать информацию (или "галлюцинировать") и способность генерировать агрессивный и вредоносный текст.

OpenAI заявляет, что уже сотрудничает с рядом компаний для интеграции GPT-4 в свои продукты, включая Duolingo, Stripe и Khan Academy. Новая модель доступна для широкой публики через ChatGPT Plus, ежемесячную подписку OpenAI на ChatGPT за 20 долларов, и используется для чат-бота Microsoft Bing. Уже стал доступен и API для разработчиков, но со списком ожидания.

В сообщении в блоге OpenAI говорится, что различие между GPT-4 и его предшественником GPT-3.5 заключается в тонкостях построения ответов. По словам разработчиков GPT-4 все еще несовершенен, все еще ограничен, но способным произвести неизгладимое впечатление при "первом контакте".

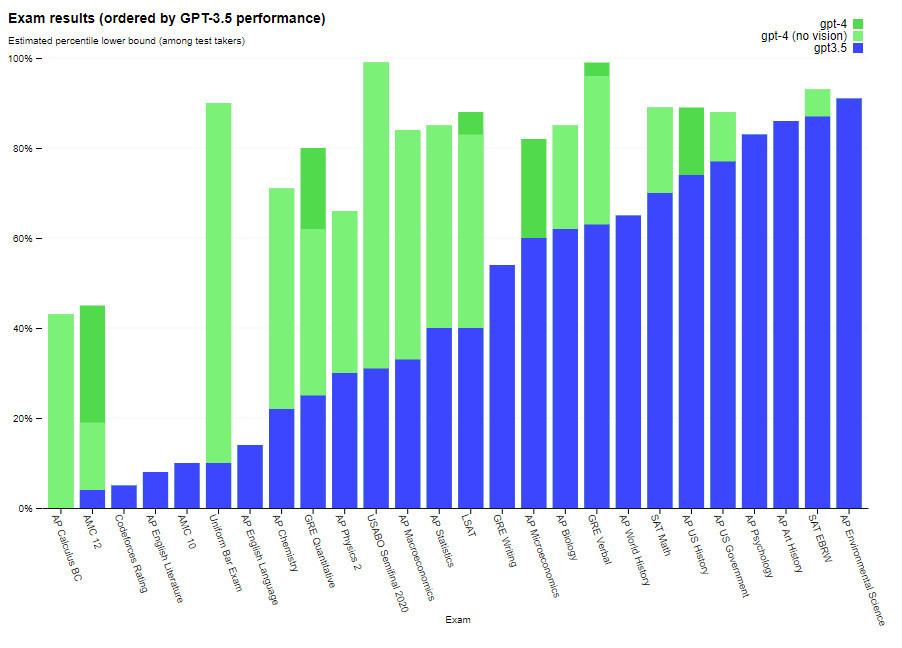

Компания заявляет, что улучшения GPT-4 заметны по ряду тестов и тестов, включая экзамены Uniform Bar Exam, LSAT, SAT Math и SAT Evidence-Based Reading & Writing. На некоторых из упомянутых экзаменов GPT-4 набрал более 88% точности.

OpenAI говорит, что система может принимать как текстовые, так и графические входные данные и выдавать текстовые выходные данные. Компания заявляет, что способность модели анализировать текст и изображение одновременно позволяет ей интерпретировать более сложные входные данные.

Путь к GPT-4 был долгим, поскольку OpenAI и языковые модели ИИ в целом медленно набирали обороты в течение нескольких лет, прежде чем в последние месяцы стали массовыми.

Первоначальная исследовательская работа, описывающая GPT, была опубликована в 2018 году, GPT-2 анонсирован в 2019 году, а GPT-3 — в 2020 году. Эти модели обучаются на огромных наборах текстовых данных, большая часть которых взята из Интернета для поиска статистических закономерностей. Затем эти шаблоны используются для предсказания того, какое слово следует за другим. Это относительно простой механизм для описания, но конечным результатом являются гибкие системы, которые могут генерировать, обобщать и перефразировать записи, а также выполнять другие текстовые задачи, такие как перевод или генерация кода.

Более широкая доступность этих языковых моделей ИИ создала проблемы и проблемы. Так, к примеру Stack Overflow и научно-фантастический журнал Clarkesworld, были вынуждены закрыть заявки из-за наплыва контента, созданного ИИ. Но некоторые эксперты утверждают, что вредные последствия все же оказались меньше, чем предполагалось.

В своем объявлении о GPT-4 OpenAI подчеркнула, что система прошла шестимесячный курс обучения технике безопасности и что во время внутренних тестов показала на 82 % меньше вероятность отвечать на запросы о запрещенном контенте и на 40 % выше вероятность предоставления фактических данных, чем GPT-3.5.

Однако это не означает, что система не допускает ошибок и не выводит вредоносный контент. Например, Microsoft сообщила, что ее чат-бот Bing все время работал на GPT-4, и многие пользователи смогли сломать барьеры Bing всевозможными творческими способами, заставив бота давать опасные советы, угрожать пользователям и выдумывать информацию. GPT-4 также до сих пор не знает о событиях, которые произошли после сентября 2021 года.