Группа исследователей из Центра познания и социальности в сочетании с Группой науки о данных Института фундаментальных наук (IBS) выявила удивительное сходство между обработкой памяти искусственного интеллекта (ИИ) и гиппокампом человеческого мозга. Это открытие бросает свет на процесс консолидации памяти в системах искусственного интеллекта, превращая краткосрочные воспоминания в долгосрочные.

В гонке за созданием общего искусственного интеллекта (AGI), где ключевую роль играют организации, такие как OpenAI и Google DeepMind, понимание и эмуляция человеческого интеллекта стало приоритетом исследований. Одним из важных технологических достижений в этой области является модель трансформатора, исследование основных принципов которой в настоящее время активно ведется.

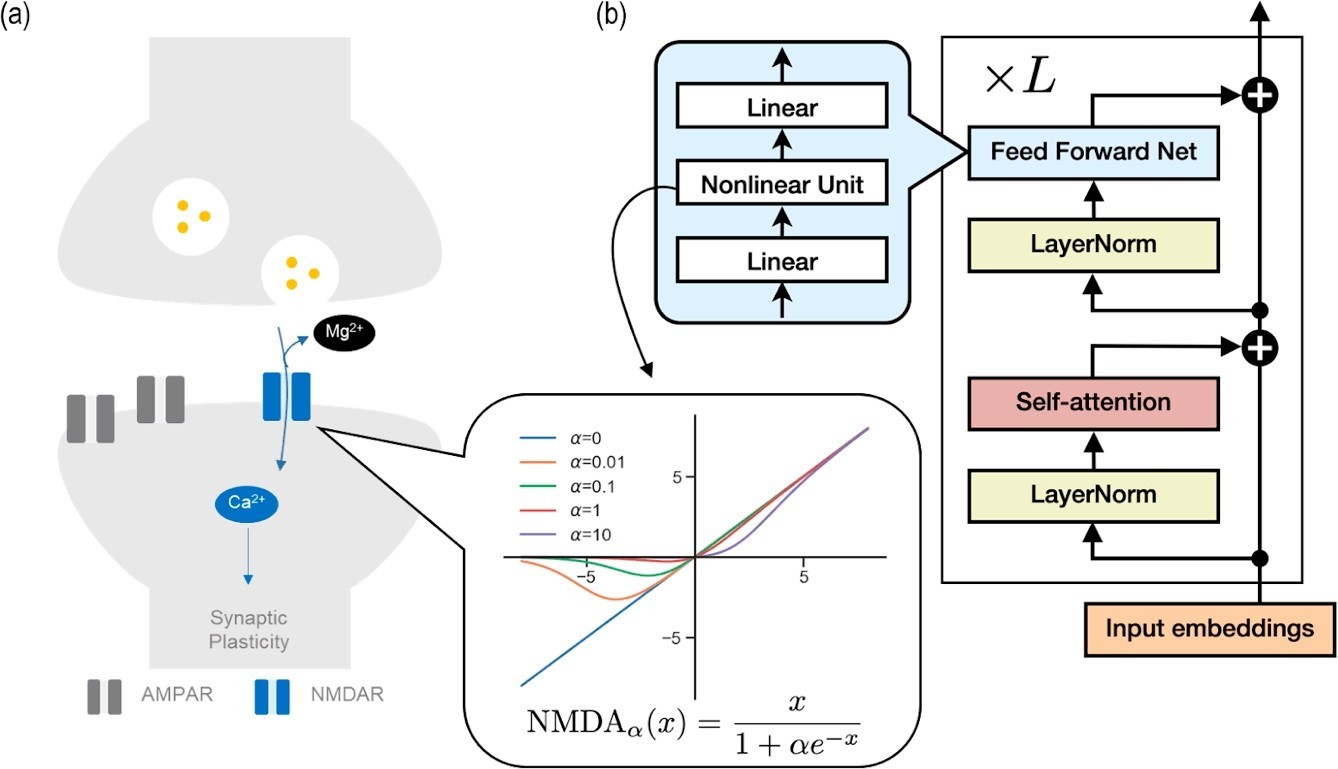

Ключ к разработке мощных систем ИИ заключается в понимании того, как эти системы обучаются и запоминают информацию. Исследователи решили приложить принципы обучения человеческого мозга, с акцентом на консолидацию памяти через NMDA-рецептор в гиппокампе, к моделям ИИ.

NMDA-рецептор можно представить как интеллектуальную дверь в мозге, упрощающую процессы обучения и формирования памяти. Когда в мозгу присутствует глутамат, нервная клетка становится возбужденной. Ион магния, выступая как небольшой заслон, блокирует дверь, позволяя веществам войти в клетку только при его отклонении. Этот процесс позволяет мозгу создавать и сохранять воспоминания, и роль ионного заслона в этом процессе чрезвычайно важна.

Ученые сделали удивительное открытие: по всей видимости, модель трансформатора использует аналогичный NMDA-рецептору процесс контроля. Это обнаружение побудило исследователей проверить возможность контролировать консолидацию памяти трансформатора с помощью механизма, подобного процессу отклонения рецептора NMDA.

Эксперименты показали, что, подобно тому, как низкий уровень магния в мозге животных ослабляет память, подстройка параметров трансформатора для отражения действия рецептора NMDA приводит к улучшению долговременной памяти в модели ИИ. Это открытие предполагает, что процессы обучения в моделях ИИ можно объяснить, опираясь на устоявшиеся принципы нейробиологии.

Директор Института по нейробиологии К. Джастин ЛИ подчеркнул:

Это исследование делает решающий вклад в развитие искусственного интеллекта и нейробиологии, позволяя более глубоко понять принципы работы мозга и создавать более совершенные системы искусственного интеллекта на основе этих знаний.

ЧА Миёнг, специалист по данным в команде и в KAIST, добавил:

Человеческий мозг уникален своей способностью функционировать с минимальным энергопотреблением, в отличие от крупных моделей искусственного интеллекта, требующих значительных ресурсов. Наша работа открывает новые перспективы для создания доступных и высокоэффективных систем искусственного интеллекта, способных изучать и запоминать информацию так, как это делает человек.

Это исследование выделяется своей попыткой интегрировать нелинейность, вдохновленную мозгом, в структуру ИИ, что представляет собой значительный прогресс в моделировании консолидации памяти, схожей с человеческой. Слияние когнитивных механизмов человека с архитектурой ИИ не только обещает создание доступных и эффективных систем ИИ, но и предоставляет ценные уроки о функционировании мозга через модели ИИ.